في تقرير حديث، كشفت Google Threat Intelligence Group عن مرحلة جديدة وأكثر خطورة في عالم الهجمات السيبرانية، حيث أصبح المهاجمون يستغلون تقنيات الذكاء الاصطناعي بشكل مباشر داخل البرمجيات الخبيثة وعمليات الاختراق. لم يعد الأمر مقتصرًا على استخدام الذكاء الاصطناعي كمساعد لكتابة الأكواد أو تسريع العمل، بل تبيّن أن جهات تهديد—including مجموعات مدعومة من دول—بدأت توظيفه لتطوير برمجيات قادرة على تعديل سلوكها لحظيًا، التخفي بذكاء أكبر، وتنفيذ هجمات ذات طابع متطور يصعب اكتشافه بالأساليب التقليدية

لأول مرة، ظهرت عائلات برمجيات خبيثة تستخدم نماذج لغوية أثناء التشغيل للتخفي أو لتوليد أكواد ضارة لحظيًا. من بينها:

PROMPTFLUX: برمجية تجريبية تعيد كتابة نفسها تلقائيًا باستخدام نماذج ذكاء اصطناعي لتفادي كشفها.

PROMPTSTEAL: تُنتج أوامر موجّهة لسرقة البيانات عبر الاستعانة بنموذج ذكاء اصطناعي خارجي بدلًا من تضمين الأوامر داخل الشيفرة مسبقًا.

هذه القدرات تزيد من قدرة البرمجيات الخبيثة على التكيّف والمراوغة، بما قد يجعل اكتشافها أصعب في المستقبل.

مثلما يخدع المخترقون البشر، بدؤوا الآن بخداع نماذج الذكاء الاصطناعي نفسها. يستخدمون “قصصًا مُقنعة” لتحييد أنظمة الحماية، مثل التظاهر بأنهم طلاب في مسابقات الأمن السيبراني أو باحثون، لانتزاع معلومات محظورة تساعدهم على بناء أدوات الهجوم.

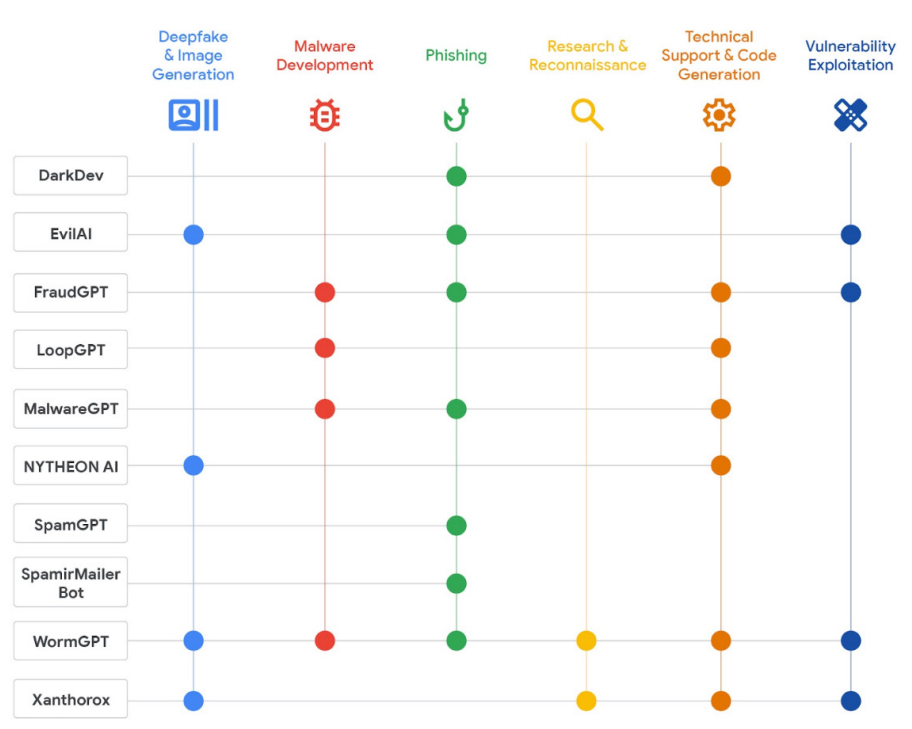

شهدت الأسواق السرية على الإنترنت انتشار خدمات مدفوعة توفر أدوات ذكاء اصطناعي مصممة خصيصًا لجرائم مثل:

إنشاء محتوى تصيّد احترافي

تطوير برمجيات خبيثة

تنفيذ أبحاث لاختراق الأنظمة

هذه الأدوات تُسهّل على غير المحترفين تنفيذ هجمات متقدمة دون خبرة تقنية كبيرة.

مجموعات مرتبطة بدول مثل الصين، روسيا، إيران، وكوريا الشمالية استخدمت الذكاء الاصطناعي في جميع مراحل الهجوم:

جمع معلومات، تصميم رسائل احتيال، كتابة أدوات اختراق، تطوير البنى التحتية للهجمات، وسرقة البيانات.

كما استُخدم الذكاء الاصطناعي لإنشاء محتوى مُقنع بلغات متعددة وتزييفات مرئية (Deepfakes) لعمليات احتيال أكثر تأثيرًا.

الهجمات أصبحت أسرع وأكثر ذكاءً ومرونة، بفضل قدرة الأدوات على التعلّم والتغيير في الوقت الحقيقي.

انخفاض حاجز الدخول: يمكن للمجرمين ذوي الخبرة المحدودة إطلاق هجمات متقدمة بسهولة.

زيادة احتمالية استهداف الأفراد والمؤسسات معًا عبر رسائل احتيال واقعية ومتقنة لغويًا وبصريًا.

تم اتخاذ إجراءات لتعطيل البنية المستخدمة في هذه الأنشطة، وتحسين قدرات الحماية داخل أنظمة الذكاء الاصطناعي. كما يستمر العمل على تطوير معايير أمنية جديدة لضمان بناء أنظمة ذكاء اصطناعي آمنة ومسؤولة، مع تعزيز قدرات الكشف عن سوء الاستخدام مبكرًا.

احذر من الرسائل غير المتوقعة حتى لو كانت تبدو شخصية أو واقعية.

حدّث أنظمة التشغيل والبرامج بانتظام واستخدم مضادّات برامج موثوقة مع ميزات سلوك لا تعتمد فقط على توقيعات قديمة.

لا تُفّتح مرفقات أو روابط من مصادر غير مؤكدة، وتحقق من صحة الطلبات المتعلقة بالمعلومات الحساسة.

المؤسسات: راجعوا سياسات الوصول، راقِبوا نشاط الشبكة، وادمجوا تقييمات تهديدات AI ضمن برامج الأمن السيبراني.

الذكاء الاصطناعي يُحسّن من قدرات المهاجمين كما يُحسّن الدفاع — الفرق أن المهاجمين يستغلون مزايا التوليد والتكيّف لزيادة فاعلية هجماتهم. التصدي لهذا التهديد يتطلب تنسيقًا أكبر بين مطوّري النماذج، فرق الأمن، وصانعي السياسات، بالإضافة إلى يقظة مستمرة من المستخدمين على مستوى الأفراد والمؤسسات.