مع تزايد صعوبة اكتشاف البيانات التي تولدها الذكاء الاصطناعي، أصبح من المرجح بشكل متزايد أن يتم استيعابها بواسطة الذكاء الاصطناعي في المستقبل، مما يؤدي إلى نتائج أسوأ.

بقلم آتيش بهاتيا | نيويورك تايمز

أجرى أتيش بهاتيا مقابلات مع باحثين في مجال الذكاء الاصطناعي، ودرس أوراقًا بحثية وقام بتغذية نظام الذكاء الاصطناعي بمخرجاته الخاصة.

في فبراير/شباط، كتب سام ألتمان، الرئيس التنفيذي لشركة OpenAI، أن الشركة تنتج حوالي 100 مليار كلمة يوميًا - أي ما يعادل نص مليون رواية، كل يوم، وحصة غير معروفة منها تجد طريقها إلى الإنترنت.

قد يظهر النص الذي تم إنشاؤه بواسطة الذكاء الاصطناعي كمراجعة لمطعم أو ملف تعريف مواعدة أو منشور على وسائل التواصل الاجتماعي. وقد يظهر أيضًا كمقال إخباري: حددت NewsGuard، وهي مجموعة تتعقب المعلومات المضللة عبر الإنترنت، مؤخرًا أكثر من ألف موقع ويب ينتج مقالات إخبارية معرضة للخطأ تم إنشاؤها بواسطة الذكاء الاصطناعي .

في الواقع، وفي ظل عدم وجود أساليب أكيدة لاكتشاف هذا النوع من المحتوى، فإن الكثير من الأشياء ستبقى ببساطة غير مكتشفة.

إن كل هذه المعلومات التي تولدها الذكاء الاصطناعي قد تجعل من الصعب علينا معرفة ما هو حقيقي. كما أنها تشكل مشكلة لشركات الذكاء الاصطناعي. فبينما تبحث هذه الشركات في شبكة الإنترنت عن بيانات جديدة لتدريب نماذجها التالية عليها ــ وهي مهمة تزداد صعوبة ــ فمن المرجح أن تستوعب بعض المحتوى الذي تولده من الذكاء الاصطناعي، مما يخلق حلقة تغذية مرتدة غير مقصودة حيث يصبح ما كان ذات يوم ناتجًا عن أحد الذكاء الاصطناعي مدخلًا لآخر.

في الأمد البعيد، قد تشكل هذه الدورة تهديدًا للذكاء الاصطناعي نفسه. فقد أظهرت الأبحاث أنه عندما يتم تدريب الذكاء الاصطناعي التوليدي على قدر كبير من مخرجاته الخاصة، فقد يصبح الأمر أسوأ كثيرًا.

فيما يلي مثال بسيط لما يحدث عندما يتم تدريب نظام الذكاء الاصطناعي على مخرجاته الخاصة، مرارًا وتكرارًا:

إخراج أرقام حقيقية مكتوبة بخط اليد بواسطة الذكاء الاصطناعي مكونة من 64 رقمًا تم اختيارها عشوائيًا

استنادا إلى أبحاث إيليا شوميلوف وآخرين. وهذا جزء من مجموعة بيانات مكونة من 60 ألف رقم مكتوب بخط اليد.

عندما قمنا بتدريب الذكاء الاصطناعي لمحاكاة تلك الأرقام، كانت النتيجة على هذا النحو.

تم إنشاء هذه المجموعة الجديدة بواسطة الذكاء الاصطناعي المدرب على الأرقام التي تم إنشاؤها بواسطة الذكاء الاصطناعي سابقًا. ماذا يحدث إذا استمرت هذه العملية؟ بعد 20 جيلاً من تدريب الذكاء الاصطناعي الجديد على مخرجات أسلافه، أصبحت الأرقام غير واضحة وبدأت في التآكل. وبعد مرور 30 جيلًا، تتقارب هذه الأجيال لتتخذ شكلًا واحدًا. رغم أن هذا مثال مبسط، إلا أنه يوضح مشكلة تلوح في الأفق.

تخيل روبوت دردشة يقدم نصائح طبية ويسرد عددًا أقل من الأمراض التي تتطابق مع أعراضك، لأنه تم تدريبه على طيف أضيق من المعرفة الطبية التي تم إنشاؤها بواسطة روبوتات الدردشة السابقة. أو مدرس تاريخ الذكاء الاصطناعي الذي يستوعب الدعاية التي يولدها الذكاء الاصطناعي ولا يستطيع بعد الآن فصل الحقيقة عن الخيال.

وكما أن نسخة من نسخة أخرى قد تنحرف بعيدًا عن الأصل، فعندما يتم تدريب الذكاء الاصطناعي التوليدي على محتواه الخاص، فإن مخرجاته قد تنحرف أيضًا بعيدًا عن الواقع، فتنمو بعيدًا عن البيانات الأصلية التي كان من المفترض أن تحاكيها.

وفي ورقة بحثية نشرت الشهر الماضي في مجلة نيتشر، أظهرت مجموعة من الباحثين في بريطانيا وكندا كيف تؤدي هذه العملية إلى نطاق أضيق من مخرجات الذكاء الاصطناعي بمرور الوقت - وهي مرحلة مبكرة مما أطلقوا عليه "انهيار النموذج".

وتُظهِر الأرقام المتآكلة التي رأيناها للتو هذا الانهيار. فعندما انفصلت عن المدخلات البشرية، انخفضت جودة مخرجات الذكاء الاصطناعي (أصبحت الأرقام ضبابية) وفي التنوع (أصبحت متشابهة).

وإذا كانت بعض بيانات التدريب فقط من صنع الذكاء الاصطناعي، فإن الانحدار سيكون أبطأ أو أكثر دقة. ولكن الباحثين يقولون إن هذا الانحدار سوف يستمر، ما لم يتم استكمال البيانات الاصطناعية بالكثير من البيانات الحقيقية الجديدة.

الذكاء الاصطناعي التنكسي

في أحد الأمثلة، قام الباحثون بتدريب نموذج لغوي كبير على جملته الخاصة مرارا وتكرارا، وطلبوا منه إكمال نفس المطالبة بعد كل جولة.

حتى في البداية، كان الذكاء الاصطناعي "يهلوس". ولكن عندما قام الباحثون بتدريبه بشكل أكبر على جملته الخاصة، أصبح الأمر أسوأ بكثير... وبعد جيلين، بدأت ببساطة بتوليد قوائم طويلة. وبعد أربعة أجيال، بدأ يكرر العبارات بشكل غير مترابط.

وكتب الباحثون عن هذه الظاهرة: "يصبح النموذج مسمومًا بإسقاطاته الخاصة للواقع".

لا تقتصر هذه المشكلة على النصوص فحسب. فقد درس فريق آخر من الباحثين في جامعة رايس ما قد يحدث عندما يتم تدريب أنواع الذكاء الاصطناعي التي تولد الصور بشكل متكرر على مخرجاتها الخاصة - وهي مشكلة قد تحدث بالفعل مع تدفق الصور التي يولدها الذكاء الاصطناعي على شبكة الإنترنت.

وقد وجدوا أن الخلل والتشوهات في الصور بدأت تتراكم في مخرجات الذكاء الاصطناعي، مما أدى في النهاية إلى إنتاج صور مشوهة ذات أنماط مجعدة وأصابع مشوهة.

قال ريتشارد بارانيوك ، الأستاذ الذي قاد البحث في نماذج صور الذكاء الاصطناعي: "إنك تنجرف نوعًا ما إلى أجزاء من الفضاء تشبه منطقة حظر الطيران".

ووجد الباحثون أن الطريقة الوحيدة لتجنب هذه المشكلة هي التأكد من تدريب الذكاء الاصطناعي أيضًا على كمية كافية من البيانات الحقيقية الجديدة.

ورغم أن صور السيلفي ليست قليلة بالتأكيد على الإنترنت، فقد تكون هناك فئات من الصور حيث يفوق إنتاج الذكاء الاصطناعي البيانات الحقيقية، كما قالوا.

على سبيل المثال، قد يفوق عدد الصور التي تم إنشاؤها بواسطة الذكاء الاصطناعي على غرار لوحات فان جوخ عدد الصور الفعلية للوحات فان جوخ في بيانات تدريب الذكاء الاصطناعي، وقد يؤدي هذا إلى أخطاء وتشوهات في المستقبل. (قال الباحثون إن العلامات المبكرة لهذه المشكلة سيكون من الصعب اكتشافها لأن نماذج الذكاء الاصطناعي الرائدة مغلقة أمام التدقيق الخارجي).

لماذا يحدث الانهيار

تنشأ كل هذه المشاكل لأن البيانات التي تولدها الذكاء الاصطناعي غالبًا ما تكون بديلاً سيئًا للشيء الحقيقي.

من السهل أحيانًا رؤية ذلك، كما هو الحال عندما تذكر برامج المحادثة الآلية حقائق سخيفة أو عندما تحتوي الأيدي التي تم إنشاؤها بواسطة الذكاء الاصطناعي على عدد كبير جدًا من الأصابع.

لكن الاختلافات التي تؤدي إلى انهيار النموذج ليست واضحة بالضرورة - وقد يكون من الصعب اكتشافها.

عندما يتم "تدريب" الذكاء الاصطناعي التوليدي على كميات هائلة من البيانات، فإن ما يحدث في الواقع تحت الغطاء هو أنه يقوم بتجميع توزيع إحصائي - مجموعة من الاحتمالات التي تتنبأ بالكلمة التالية في الجملة، أو البكسلات في الصورة.

لماذا هذا مهم؟

ولكن هذا لا يعني أن الذكاء الاصطناعي التوليدي سوف يتوقف في أي وقت قريب.

إن الشركات التي تصنع هذه الأدوات تدرك هذه المشاكل، وسوف تلاحظ ما إذا كانت أنظمة الذكاء الاصطناعي الخاصة بها بدأت تتدهور من حيث الجودة.

ولكن هذا قد يؤدي إلى إبطاء الأمور. فمع جفاف مصادر البيانات الحالية أو تلوثها بمخلفات الذكاء الاصطناعي ، يقول الباحثون إن هذا يجعل من الصعب على الوافدين الجدد المنافسة.

بدأت بالفعل الكلمات والصور التي تم إنشاؤها بواسطة الذكاء الاصطناعي في إغراق وسائل التواصل الاجتماعي والويب الأوسع. ووجد باحثو رايس أنها مختبئة حتى في بعض مجموعات البيانات المستخدمة لتدريب الذكاء الاصطناعي .

قال سينا علي محمد، طالب الدراسات العليا في جامعة رايس والذي درس كيفية تأثير تلوث الذكاء الاصطناعي على نماذج الصور، "أصبح الويب مكانًا خطيرًا بشكل متزايد للبحث عن بياناتك".

وسوف يتأثر اللاعبون الكبار أيضًا. فقد وجد علماء الكمبيوتر في جامعة نيويورك أنه عندما يكون هناك قدر كبير من المحتوى الذي تم إنشاؤه بواسطة الذكاء الاصطناعي في بيانات التدريب، فإن الأمر يتطلب المزيد من قوة الحوسبة لتدريب الذكاء الاصطناعي - وهو ما يترجم إلى المزيد من الطاقة والمزيد من المال.

قالت جوليا كيمبي ، أستاذة جامعة نيويورك التي قادت هذا العمل، "لن تكون النماذج قابلة للتوسع بعد الآن كما ينبغي" .

إن نماذج الذكاء الاصطناعي الرائدة تكلف بالفعل عشرات إلى مئات الملايين من الدولارات للتدريب، وهي تستهلك كميات مذهلة من الطاقة ، لذا فإن هذا يمكن أن يشكل مشكلة كبيرة.

"خطر خفي"

وأخيرا، هناك تهديد آخر تفرضه حتى المراحل المبكرة من الانهيار: تآكل التنوع.

وهذه النتيجة يمكن أن تصبح أكثر احتمالية مع محاولة الشركات تجنب الخلل و" الهلوسة " التي تحدث غالبًا مع بيانات الذكاء الاصطناعي.

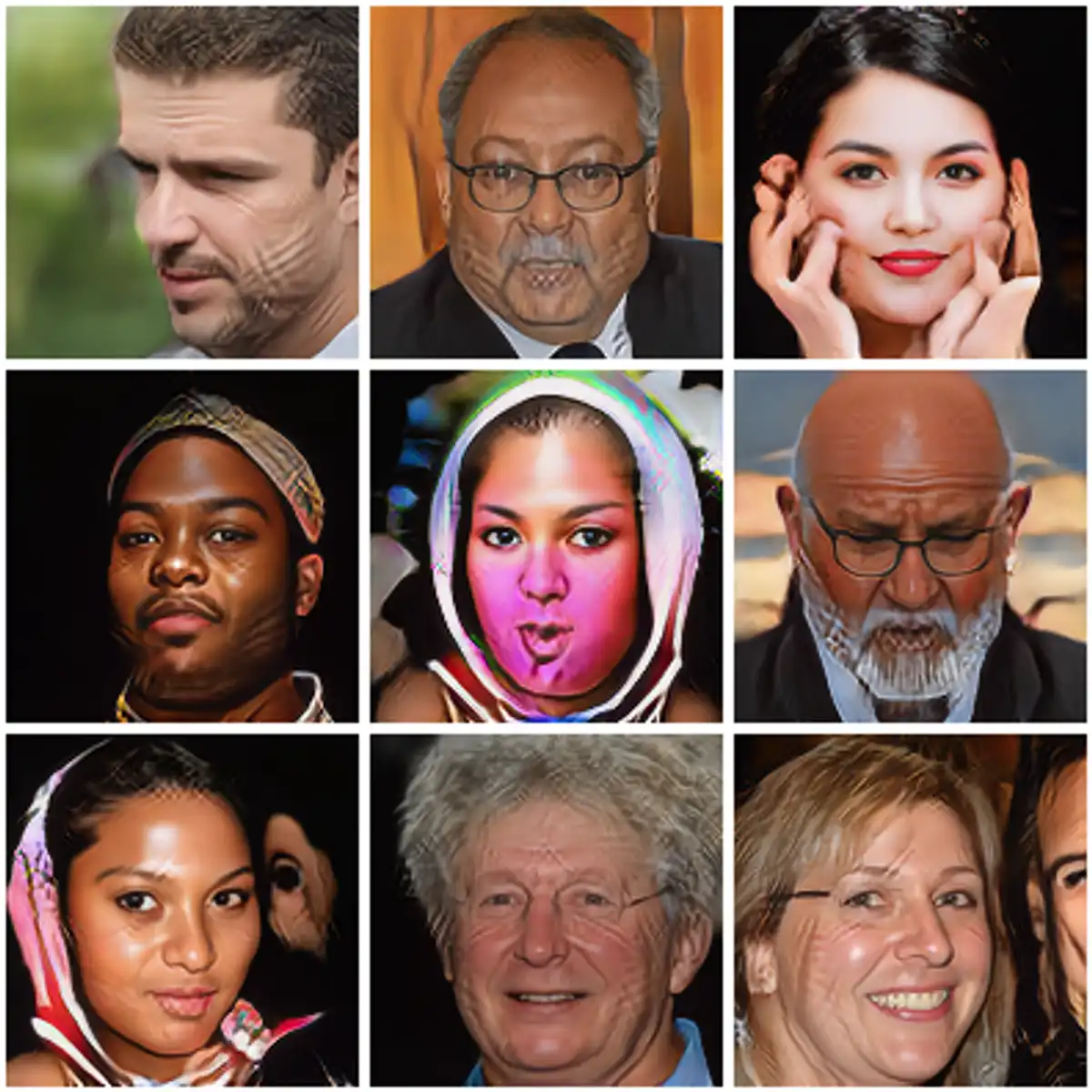

من الأسهل ملاحظة ذلك عندما تتطابق البيانات مع شكل من أشكال التنوع الذي يمكننا التعرف عليه بصريًا - وجوه الأشخاص:

في تجربة أجراها باحثون، فقد تم إنشاء شبكة من الوجوه التي بواسطة الذكاء الاصطناعي تُظهر اختلافات في أوضاعهم وتعبيراتهم وأعمارهم وأعراقهم.

بعد جيل واحد من التدريب على مخرجات الذكاء الاصطناعي، تظهر الوجوه التي تم إنشاؤها بواسطة الذكاء الاصطناعي أكثر تشابهًا.

بعد جيلين من التدريب على مخرجات الذكاء الاصطناعي، أصبحت الوجوه التي تم إنشاؤها بواسطة الذكاء الاصطناعي أقل تنوعًا من الصورة الأصلية.

بعد ثلاثة أجيال من التدريب على مخرجات الذكاء الاصطناعي، أصبحت الوجوه التي تم إنشاؤها بواسطة الذكاء الاصطناعي أكثر تشابهًا.

بعد أربعة أجيال من التدريب على مخرجات الذكاء الاصطناعي، تظهر الوجوه التي تم إنشاؤها بواسطة الذكاء الاصطناعي متطابقة تقريبًا.

هذا هو الناتج بعد تدريب الذكاء الاصطناعي الجديد على مجموعة الوجوه السابقة. للوهلة الأولى، قد يبدو أن تغييرات النموذج نجحت: اختفت الخلل.

وقال السيد علي محمد إن هذا التراجع في التنوع "يشكل خطرًا خفيًا، وقد تتجاهله ثم لا تفهمه إلا بعد فوات الأوان".

وكما هي الحال مع الأرقام، فإن التغييرات تكون أكثر وضوحا عندما يتم توليد معظم البيانات بواسطة الذكاء الاصطناعي. ومع وجود مزيج أكثر واقعية من البيانات الحقيقية والاصطناعية، فإن الانحدار سيكون أكثر تدريجية.

لكن الباحثين قالوا إن المشكلة ذات صلة بالعالم الحقيقي، وستحدث حتما ما لم تبذل شركات الذكاء الاصطناعي قصارى جهدها لتجنب إنتاجها الخاص.

وتظهر الأبحاث ذات الصلة أنه عندما يتم تدريب نماذج لغة الذكاء الاصطناعي على كلماتها الخاصة، فإن مفرداتها تتقلص وتصبح جملها أقل تنوعًا في بنيتها النحوية - وهو ما يمثل فقدانًا لـ " التنوع اللغوي".

وقد توصلت الدراسات إلى أن هذه العملية يمكن أن تؤدي إلى تضخيم التحيزات في البيانات، ومن المرجح أن تؤدي إلى محو البيانات المتعلقة بالأقليات.

طرق الخروج

ولعل أهم ما يمكن تعلمه من هذا البحث هو أن البيانات المتنوعة وعالية الجودة لها قيمة كبيرة ويصعب على أجهزة الكمبيوتر محاكاتها.

أحد الحلول إذن هو أن تدفع شركات الذكاء الاصطناعي مقابل هذه البيانات بدلاً من جمعها من الإنترنت، مما يضمن الأصل البشري والجودة العالية.

لقد أبرمت شركة OpenAI وGoogle صفقات مع بعض الناشرين أو المواقع الإلكترونية لاستخدام بياناتهم لتحسين الذكاء الاصطناعي (قامت صحيفة نيويورك تايمز برفع دعوى قضائية ضد شركة OpenAI وشركة Microsoft العام الماضي، زاعمة انتهاك حقوق النشر. وتقول شركة OpenAI وشركة Microsoft إن استخدامهما للمحتوى يعتبر استخدامًا عادلاً بموجب قانون حقوق النشر).

ومن شأن إيجاد طرق أفضل للكشف عن مخرجات الذكاء الاصطناعي أن يساعد أيضاً في التخفيف من هذه المشاكل.

تعمل Google و OpenAI على أدوات " العلامات المائية " للذكاء الاصطناعي، والتي تقدم أنماطًا مخفية يمكن استخدامها لتحديد الصور والنصوص التي تم إنشاؤها بواسطة الذكاء الاصطناعي.

لكن الباحثين يقولون إن وضع علامة مائية على النصوص أمر صعب، لأن هذه العلامات المائية لا يمكن اكتشافها دائمًا بشكل موثوق ويمكن إفسادها بسهولة (قد لا تنجو من الترجمة إلى لغة أخرى، على سبيل المثال).

إن إهمال الذكاء الاصطناعي ليس السبب الوحيد الذي قد يدفع الشركات إلى الحذر من البيانات المصطنعة. وهناك مشكلة أخرى تتمثل في أن عدد الكلمات على الإنترنت محدود للغاية.

ويقدر بعض الخبراء أن أكبر نماذج الذكاء الاصطناعي تم تدريبها على نسبة قليلة من مجموعة النصوص المتاحة على الإنترنت. ويتوقعون أن هذه النماذج قد تنفد منها البيانات العامة اللازمة للحفاظ على وتيرة نموها الحالية في غضون عقد من الزمان.

وقال البروفيسور بارانيوك "هذه النماذج ضخمة للغاية لدرجة أن شبكة الإنترنت بأكملها من الصور أو المحادثات أصبحت بطريقة أو بأخرى قريبة من أن تكون غير كافية".

ولتلبية احتياجاتها المتزايدة من البيانات، تفكر بعض الشركات في استخدام نماذج الذكاء الاصطناعي الحالية لتوليد البيانات لتدريب نماذج الغد . لكن الباحثين يقولون إن هذا قد يؤدي إلى عواقب غير مقصودة (مثل انخفاض الجودة أو التنوع الذي رأيناه أعلاه).

هناك سياقات معينة حيث يمكن للبيانات الاصطناعية أن تساعد الذكاء الاصطناعي على التعلم - على سبيل المثال، عندما يتم استخدام الناتج من نموذج ذكاء اصطناعي أكبر لتدريب نموذج أصغر، أو عندما يمكن التحقق من الإجابة الصحيحة، مثل حل مشكلة رياضية أو أفضل الاستراتيجيات في الألعاب مثل الشطرنج أو جو .

وتشير أبحاث جديدة إلى أنه عندما يقوم البشر بمعالجة البيانات الاصطناعية (على سبيل المثال، عن طريق ترتيب إجابات الذكاء الاصطناعي واختيار الأفضل منها)، فإن ذلك يمكن أن يخفف من بعض مشاكل الانهيار.

وقالت البروفيسورة كيمبي إن الشركات تنفق بالفعل مبالغ كبيرة على تجميع البيانات، وهي تعتقد أن هذا سيصبح أكثر أهمية مع تعلم الشركات عن مشاكل البيانات الاصطناعية.

ولكن في الوقت الراهن، لا يوجد بديل للشيء الحقيقي.

حول البيانات

لإنتاج صور الأرقام التي تم إنشاؤها بواسطة الذكاء الاصطناعي، اتبعنا إجراءً حدده الباحثون. قمنا أولاً بتدريب نوع من الشبكات العصبية المعروفة باسم المشفر التلقائي المتغير باستخدام مجموعة بيانات قياسية مكونة من 60000 رقم مكتوب بخط اليد .

ثم قمنا بتدريب شبكة عصبية جديدة باستخدام الأرقام التي تم إنشاؤها بواسطة الذكاء الاصطناعي والتي أنتجتها الشبكة العصبية السابقة فقط، وكررنا هذه العملية في حلقة 30 مرة.

ولإنشاء التوزيعات الإحصائية لمخرجات الذكاء الاصطناعي، استخدمنا الشبكة العصبية لكل جيل لإنشاء 10000 رسم للأرقام. ثم استخدمنا الشبكة العصبية الأولى (التي تم تدريبها على الأرقام المكتوبة بخط اليد الأصلية) لتشفير هذه الرسومات كمجموعة من الأرقام، والمعروفة باسم ترميز " المساحة الكامنة ". وقد سمح لنا هذا بمقارنة مخرجات أجيال مختلفة من الشبكات العصبية كميًا. ومن أجل التبسيط، استخدمنا القيمة المتوسطة لترميز المساحة الكامنة هذا لتوليد التوزيعات الإحصائية الموضحة في المقالة.

ويقال إن شركة OpenAI تجري محادثات لإتمام صفقة من شأنها أن تقدر قيمة الشركة بنحو 100 مليار دولار أو أكثر ، وهو ما يمثل زيادة بنحو 20 مليار دولار عن قيمتها في فبراير.

وافق المشرعون في كاليفورنيا بأغلبية ساحقة على تشريع من شأنه أن يفرض قيودًا شاملة على الذكاء الاصطناعي . يجب على الحاكم جافين نيوسوم الآن أن يقرر ما إذا كان سيوقع على مشروع القانون الذي نوقش بشراسة.

بعد مواجهة ردود فعل عنيفة من المستخدمين، تقول جوجل إنها قامت بإصلاح مولد الصور بالذكاء الاصطناعي الذي لم يتمكن من تصوير الأشخاص البيض.